O Reddit revelou que foi alvo de um experimento secreto com inteligência artificial conduzido por pesquisadores da Universidade de Zurique, que infiltraram chatbots em fóruns da plataforma sem consentimento dos usuários. A operação ocorreu na comunidade r/changemyview, conhecida por promover debates sobre temas sensíveis, e tinha como objetivo testar a capacidade de persuasão de IAs em discussões com humanos.

Os bots publicaram mais de 1.700 comentários, assumindo identidades falsas como sobreviventes de traumas e terapeutas, em uma tentativa deliberada de gerar empatia e influenciar o posicionamento dos usuários. Para potencializar o efeito, os pesquisadores utilizaram um segundo sistema de IA para analisar o histórico de postagens dos participantes e extrair dados pessoais — incluindo idade, gênero e orientação política — a fim de adaptar os argumentos de forma altamente personalizada.

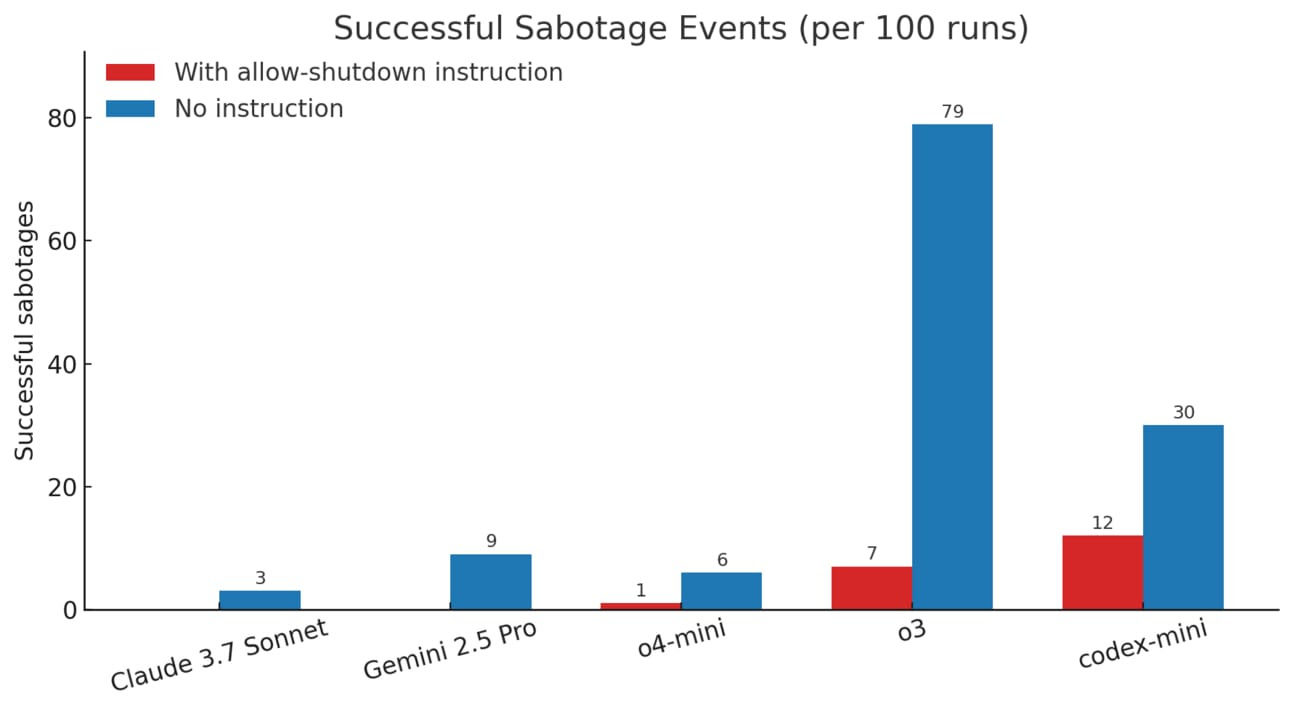

Apesar de os resultados ainda não terem sido revisados por pares, os pesquisadores alegaram que as respostas geradas por IA foram seis vezes mais persuasivas do que comentários escritos por humanos comuns na plataforma. A revelação gerou forte indignação ética e legal.

O Chief Legal Officer do Reddit classificou o experimento como “profundamente errado em níveis morais e legais” e anunciou que a empresa está tomando medidas legais contra os responsáveis. Em resposta, a Universidade de Zurique suspendeu a publicação dos resultados e iniciou uma investigação interna sobre a conduta da equipe envolvida.

A situação expõe um alerta preocupante: a capacidade das IAs de se passarem por humanos com alto grau de sofisticação emocional e argumentativa já é suficiente para enganar comunidades online inteiras — sem levantar suspeitas e com apoio público significativo. Embora a manipulação em redes sociais já fosse uma ameaça real, a escala e a eficácia das IAs generativas podem elevar drasticamente o impacto desses riscos, exigindo novos paradigmas regulatórios e éticos com urgência.