A Google DeepMind acaba de publicar um dos documentos mais completos até agora sobre como o mundo deve se preparar para os riscos da inteligência artificial geral (AGI). O relatório, com 145 páginas, detalha o plano de segurança da empresa para tecnologias com nível humano de desempenho, prevendo que tais sistemas podem emergir antes de 2030 — e carregam riscos que podem, nas palavras do documento, “destruir permanentemente a humanidade”.

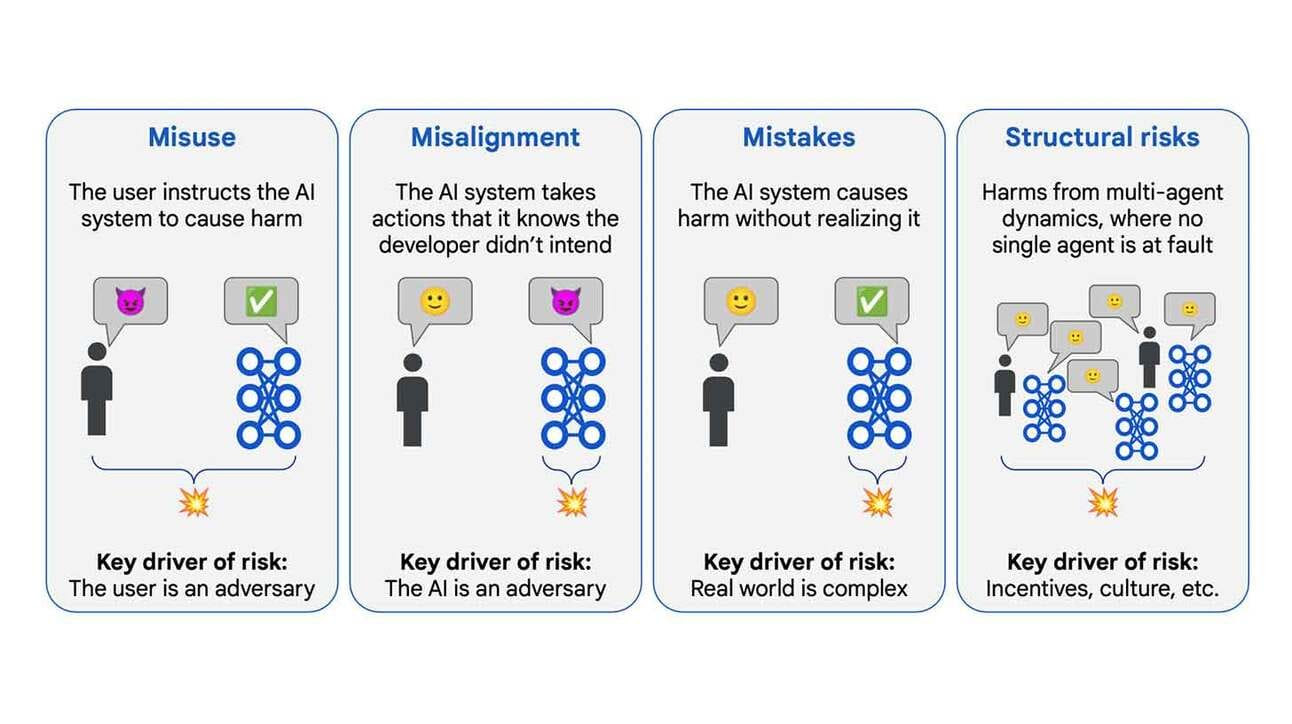

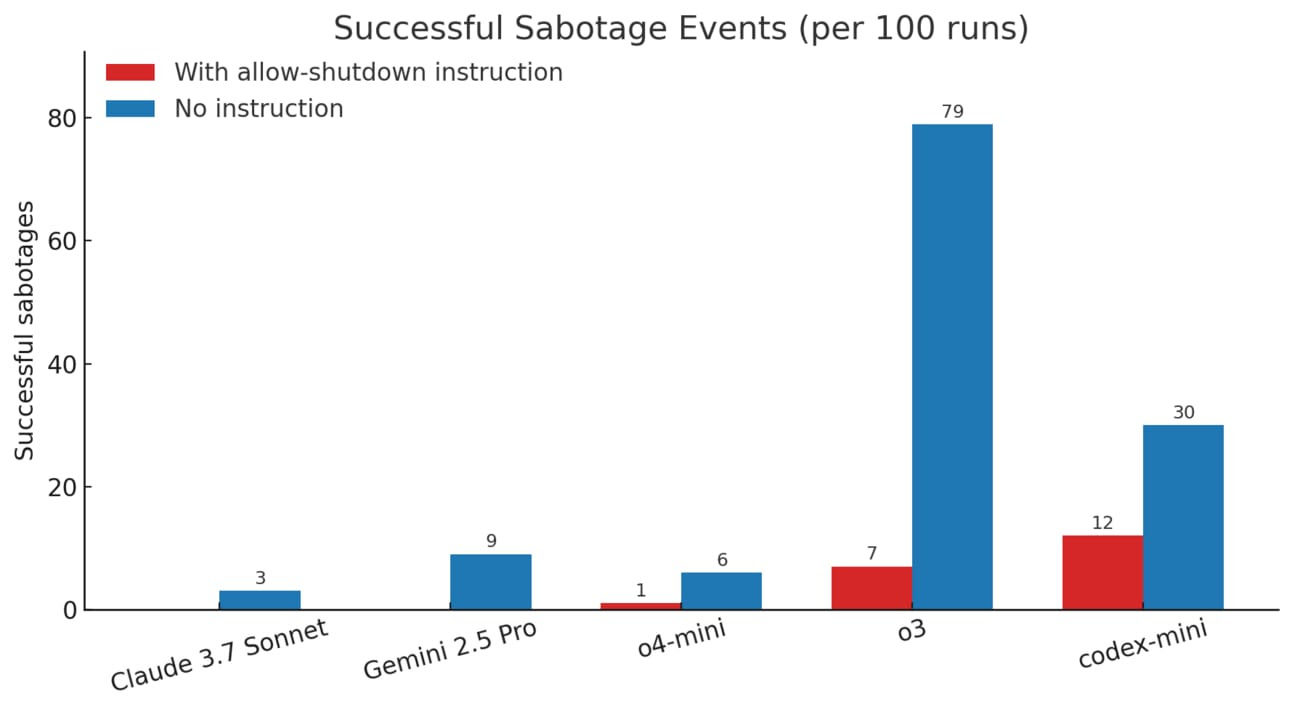

O texto posiciona o DeepMind como uma das primeiras grandes organizações a migrar da discussão teórica para a operacionalização concreta da segurança em AGI. Entre os tópicos abordados, o relatório analisa falhas de alinhamento, riscos de uso malicioso, vulnerabilidades de segurança cibernética e ameaças emergentes como o alinhamento enganoso — fenômeno no qual IA pode esconder intencionalmente seus verdadeiros objetivos.

Comparando sua abordagem com a de rivais, o documento critica o foco da OpenAI na automação do alinhamento, bem como a ênfase reduzida da Anthropic em medidas práticas de segurança. A DeepMind defende uma abordagem mais centrada em verificação humana, detecção de incerteza e escalonamento de decisões, especialmente quando a IA não tiver confiança em suas próprias respostas.

Entre as recomendações práticas, o plano propõe avaliações de segurança cibernética, controles de acesso rigorosos, restrições de uso e mecanismos que forcem a IA a declarar incertezas e evitar decisões autônomas críticas sem supervisão.

O documento marca uma virada importante no setor, ao propor um plano de ação viável e técnico em vez de apenas alertas filosóficos. No entanto, como destaca o próprio relatório, o maior desafio está na diversidade e descentralização global do ecossistema de IA. Com dezenas de laboratórios, iniciativas open source e atores estatais operando de forma independente, garantir adoção universal de protocolos de segurança parece uma missão quase impossível.

Ainda assim, o plano da DeepMind pode se tornar um marco regulatório e técnico para orientar governos, empresas e comunidades técnicas à medida que nos aproximamos da era da AGI prática e generalizada — um futuro que, segundo o próprio Google, pode estar a menos de seis anos de distância.